Voy a prescindir de los tópicos utilizados en este tipo de artículos, como que los datos son el nuevo petróleo o los estadios de fútbol que se podrían llenar con los datos generados diariamente. Si has llegado hasta esta entrada es porque seguramente ya hayas oído lo que significa la Inteligencia Artificial (IA) y el impacto que va a tener en muchas profesiones, incluida la medicina.

No hay duda de que la IA es capaz de realizar ciertas tareas mucho mejor que los humanos. Uno de sus puntos fuertes es la capacidad de descubrir patrones. Algunas especialidades dentro de la medicina incluyen la oftalmología, mediante el análisis de fotografías de fondo de ojo. También el diseño de medicamentos, encontrando las moléculas más efectivas contra una determinada enzima o agente, o en radiografías, detectando detalles en la escala de grises que puedan señalar un tumor.

A diferencia de otros casos de uso, las implicaciones del uso de un algoritmo de IA en medicina son mucho mayores. ¿Nos fiaríamos del resultado de un algoritmo que implique una operación peligrosa para el paciente o una quimioterapia agresiva? A medida que la IA ha ido abandonando el ámbito de casos de uso más sencillos, como recomendar la siguiente serie o película para un domingo por la tarde o buscar fotos de gatitos en nuestro móvil, este efecto de opacidad de la IA o problema de «caja negra» ha cobrado más importancia tanto en la academia como en la industria.

El problema de la caja negra en Inteligencia Artificial

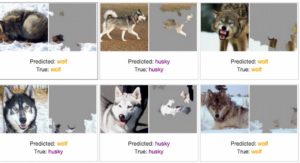

Muchos algoritmos de IA son una caja negra en la cual introducimos una serie de datos, como imágenes radiográficas o el cardiograma histórico del paciente, y nos proporcionan unos resultados ya “masticados”. El proceso entre medias por el cual se calcula este resultado es totalmente opaco. Pensemos en una red neuronal donde las entradas son transformadas a través de las múltiples capas del algoritmo. ¿Cómo podemos establecer la correlación entre las entradas y salidas? Sin duda, es un problema no trivial, pero totalmente necesario para poder encontrar fallos en el modelo predictivo o sesgos ocultos en los datos. Un ejemplo lo podemos encontrar en un estudio realizado por la Universidad de Washington titulado “Why Should I Trust You? Explaining the Predictions of Any Classifier”. El objetivo era construir un modelo de IA capaz de distinguir entre los perros husky y lobos. Los investigadores introdujeron un sesgo a propósito: todas las fotos de lobos utilizadas para entrenar el modelo se mostraban en un entorno nevado. En la imagen se puede ver cuáles son los pixeles que el algoritmo consideraba más importante a la hora de clasificar una imagen. Lo que en realidad el modelo había aprendido es que, si hay nieve en la imagen, entonces tiene que ser un lobo. El modelo para distinguir huskies de lobos se había convertido, básicamente, en un detector de nieve. Este fallo sería imposible de detectar si el algoritmo se comporta como una caja negra. Pero entonces, ¿cómo obtuvieron los píxeles más importantes si hemos dicho que muchos algoritmos de IA (redes neuronales en este caso) son indescifrables?

En la imagen se pueden ver los píxeles más importantes según el algoritmo de IA a la hora de distinguir entre husky o lobo. El algoritmo considera que los pixeles blancos que representan la nieve son los que distinguen al lobo ya que todas las imágenes de lobos en el conjunto de datos fueron tomadas en la nieve

Convertir la caja en transparente

Esta necesidad de aumentar la confianza en los modelos de IA ha dado lugar a nuevos avances y técnicas estadísticas que son capaces de explicar su funcionamiento. Por ejemplo, la librería LIME, la cual fue creada por los mismos investigadores que utilizaron el problema de huskies versus lobos para mostrar la importancia de una IA transparente. Otras librerías como SHAP, la cual está basada en conceptos de la teoría de juegos, permiten explicar el impacto de cada entrada de datos en el resultado. En la imagen se puede ver un ejemplo de modelo que fue entrenado para predecir si un equipo de fútbol iba a tener a uno de los jugadores de la jornada en sus filas. Algunas características que el modelo considera como positivas en un equipo son el número de goles, córneres provocados o tiros a puerta. Otras, serían negativas, como una baja posesión del balón. En definitiva, lo que el modelo nos confirma es que los equipos ofensivos y que marcan goles son más propensos a tener un jugador destacado en la jornada.

La Inteligencia Artificial en el ámbito de la salud

Tan solo estamos ante la punta del iceberg. Los avances que pueden brindar el análisis de miles de variables mediante la Inteligencia Artificial van a cambiar el mundo de la medicina y la calidad de nuestras vidas de una forma significativa. Esto no quiere decir que los doctores vayan a ser prescindibles en un futuro. Todo lo contrario. Mediante la IA el médico no tiene que limitarse a un número limitado de medidas e indicadores que puedan caber en su cabeza para emitir un diagnóstico. Una IA que proporcione explicaciones para sus diagnósticos y que pueda ser entendible por un humano, se convierte en una potentísima herramienta para sintetizar toda la información adicional que el médico podría estar pasando por alto. El resultado es una medicina mucho más precisa e informada.

Este artículo está elaborado por Álvaro Brandon, PhD en Inteligencia Artificial y profesor en el Máster ISD.

En el master ISD de la Universidad Complutense de Madrid vas a aprender los conceptos estadísticos que hay detrás de estos algoritmos de IA para convertir esa caja negra y opaca en un libro abierto que eleve la medicina y la salud al siguiente nivel. No pierdas la oportunidad de formar parte de esta nueva revolución digital.